Unternehmen sollen Künstliche Intelligenz (KI) verantwortungsvoll nutzen – das ist das Ziel der KI-Verordnung (KI-VO, auf Englisch: AI Act). Mit diesem Gesetz hat die Europäische Union (EU) einheitliche Regeln für KI festgelegt, bei Verstößen drohen Strafen. Für viele Firmen sind die Vorschriften momentan noch undurchsichtig, insbesondere für kleine und mittlere Unternehmen (KMU) ohne eigene Rechtsabteilung. Im Forschungsprojekt AI Act-Ready entwickeln das IPH – Institut für Integrierte Produktion Hannover und das IRI – Institut für Rechtsinformatik der Leibniz Universität Hannover gemeinsam einen Leitfaden, der die KI-Verordnung und die damit verbundenen Pflichten verständlich und praxisnah erklärt. Derzeit suchen die Wissenschaftler nach produzierenden Unternehmen, die KI nutzen und zum Forschungsprojekt beitragen wollen.

Mit KI können in fast allen Unternehmensbereichen Aufgaben schneller erledigt werden – von Angeboten zur Senkung der Stromkosten bis zur Qualitätssicherung. Auch in der Ausbildung kann KI zum Einsatz kommen – etwa um Berufsanfängern individuelles Feedback zu ihrer Arbeit zu geben. Solche Anwendungen gibt es bereits in niedersächsischen Firmen.

Doch neben Vorteilen birgt KI auch Risiken. Um einen verantwortungsvollen Umgang sicherzustellen, hat die Europäische Union (EU) mit der KI-Verordnung erstmals einheitliche Regeln für die Nutzung festgelegt.

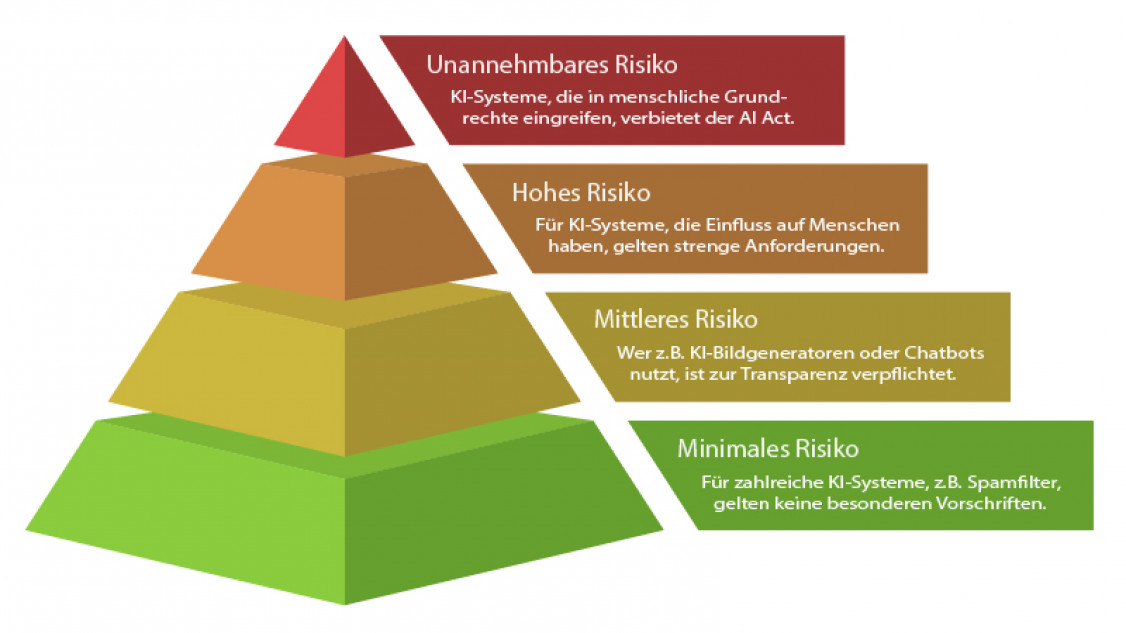

Je höher das Risiko der KI, desto strenger sind die Vorschriften der EU

Die KI-Verordnung der EU teilt KI in vier verschiedene Risikoklassen ein:

KI-Systeme mit unannehmbarem Risiko hat die EU komplett verboten. Dazu gehört etwa das Social Scoring, mit dem Behörden oder Unternehmen menschliches Verhalten bewerten können – etwa, indem sie den öffentlichen Raum überwachen und mithilfe von KI versuchen, Straftaten vorherzusagen und Menschen präventiv festzunehmen. Weil derartige KI-Systeme in die Grundrechte von Menschen eingreifen, dürfen sie in der EU nicht zum Einsatz kommen.

Für KI-Systeme mit hohem Risiko gelten besonders strenge Anforderungen. Als hochriskant gilt jegliche KI, die Einfluss auf Menschen hat. Das ist beispielsweise der Fall, wenn Personalabteilungen KI nutzen, um Bewerbungen auszusortieren, oder wenn ein Hersteller von medizinischen Geräten KI nutzt, um Produktionsfehler zu erkennen. Die KI-Verordnung verpflichtet Unternehmen unter anderem, solche Systeme unter menschliche Aufsicht zu stellen und nur hochwertige Datensätze zu verwenden, um die KI zu trainieren.

Für KI-Systeme mit mittlerem Risiko gelten besondere Transparenzverpflichtungen. Nutzer müssen deutlich darauf hingewiesen werden, dass sie es beispielsweise in der Kundenberatung mit einem Chatbot statt mit einem Menschen zu tun haben. Texte oder Bilder, die mithilfe von KI erzeugt wurden, müssen entsprechend gekennzeichnet werden – egal, ob es sich um einen Social-Media-Beitrag oder um eine mit KI geschriebene Bedienungsanleitung handelt.

Zu KI-Systemen mit minimalem Risiko zählen beispielsweise Spamfilter. Hier müssen Unternehmen keine speziellen Pflichten erfüllen – sie dürfen aber freiwillig zusätzliche Verhaltensregeln für die Nutzung aufstellen.

KI-Verordnung: Sinnvolles Risiko-Management oder Hindernis für Innovation?

„Ein verantwortungsvoller Umgang mit KI ist wichtig, die Regeln der EU sind also durchaus sinnvoll“ sagt Denise Wullfen, Wissenschaftliche Mitarbeiterin und KI-Expertin am IPH – Institut für Integrierte Produktion Hannover. „Aber für Unternehmen ist das Regelwerk momentan noch schwer zu durchschauen.“ Die Hürde, KI zu nutzen, werde aus Angst vor Strafen noch höher – schließlich müssen Unternehmen, die gegen die KI-Verordnung verstoßen, bis zu 20 Millionen Euro Strafe zahlen. Vor allem kleine und mittlere Unternehmen (KMU) ohne eigene Rechtsabteilung hätten es momentan schwer, herauszufinden, was sie beim Einsatz von KI konkret beachten müssen, so Wullfen.

Auf die Nutzung von KI zu verzichten, um Strafen zu vermeiden, ist allerdings keine Lösung. Damit hätten Unternehmen einen großen Wettbewerbsnachteil gegenüber der Konkurrenz, die KI nutzt. Zudem müssen Unternehmen ihren Mitarbeitern klare Vorgaben machen, sonst entsteht sogenannte Schatten-KI. „Tools wie Chat-GPT gehören für viele Menschen schon so sehr zum Alltag, dass die Versuchung groß ist, sie auch im Beruf zu nutzen“, sagt Wullfen. Unternehmen können das Thema nicht ignorieren, sondern müssen die KI-Nutzung entweder klar verbieten oder aber regulieren. Für beides brauchen Unternehmen eine KI-Richtlinie.

Juristen und KI-Experten starten gemeinsames Forschungsprojekt

Um KMU die rechtssichere Nutzung von KI zu ermöglichen, hat das IPH gemeinsam mit dem Lehrstuhl für Bürgerliches Recht und IT-Recht am IRI – Institut für Rechtsinformatik der Leibniz Universität Hannover das interdisziplinäre Forschungsprojekt AI Act-Ready gestartet.

KI-Expertinnen und Juristinnen entwickeln für produzierende KMU zwei Hilfen: einen verständlichen Leitfaden zu den neuen KI-Vorschriften und einen Software-Demonstrator. Mit diesem können Unternehmen die Risikoklasse einer KI-Anwendung bestimmen, die Nutzungsbedingungen herausfinden und prüfen, ob sich der Einsatz trotz aller Vorgaben und Risiken für das Unternehmen lohnt. Außerdem können die Unternehmen einen Entwurf für eine eigene KI-Richtlinie erstellen.

Mit diesen Hilfestellungen wollen die Forschenden produzierenden KMU die Angst vor der KI-Verordnung nehmen – damit das Gesetz nicht zum Hindernis für Innovationen wird, sondern einen verlässlichen Rahmen bietet, um KI rechtssicher zu nutzen und wettbewerbsfähig zu bleiben.

Gesucht: Produzierende Unternehmen, die sich am Forschungsprojekt beteiligen wollen

Gesucht: Produzierende Unternehmen, die sich am Forschungsprojekt beteiligen wollenaFür das Forschungsprojekt suchen das IPH und das IRI noch produzierende KMU, die bereits KI nutzen oder den Einsatz von KI in naher Zukunft planen. Im Projektbegleitenden Ausschuss (PA) des Forschungsprojekts erhalten sie die Gelegenheit, sich mit den KI-Experten und Juristen über ihre konkreten Anwendungsfälle auszutauschen und herauszufinden, was sie konkret tun müssen, um die KI-Verordnung einzuhalten.

Unternehmen, die daran Interesse haben, melden sich bis zum 30. September 2025 bei Denise Wullfen unter der Telefonnummer +49 511 27976 442 oder per E-Mail an wullfen@iph-hannover.de.

(Quelle: IPH - Institut für Integrierte Produktion Hannover gemeinnützige GmbH)

Schlagworte

KIKI-VerordnungLeitfadenRechtssicherheitRichtlinieVorschrift